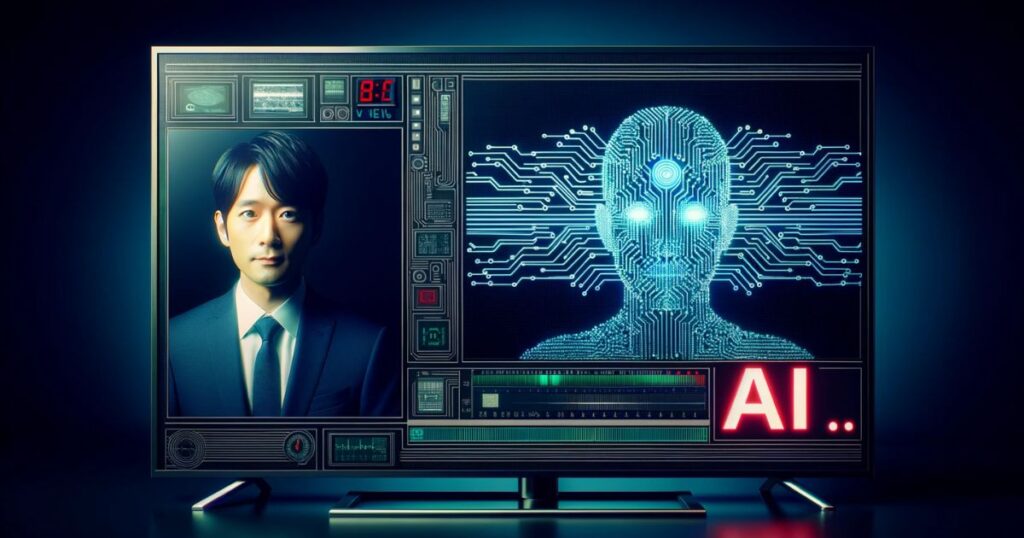

最近、SNS上で生成AIを利用して作成された、実在のアナウンサーの声や動きを模倣した偽の広告動画が拡散しています。

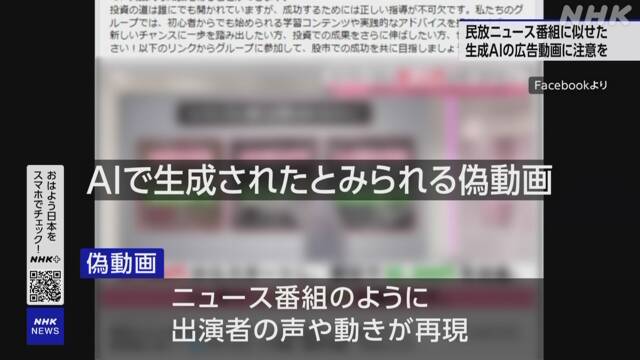

この動画は、投資情報サイトへの登録を促す内容となっており、日本テレビが公式に注意を呼びかける事態となっています。

このニュースのポイント:

- 生成AIを使用して、実在のアナウンサーの声や動きを模倣した偽の広告動画がSNSで拡散。

- 動画は投資情報サイトへの登録を促す内容。

- 日本テレビが注意を呼びかけ、関与していないことを明確に声明。

生成AIによる偽動画の実態

偽の広告動画は、実在する女性アナウンサーが投資情報サイトへの登録や投資を呼びかける内容となっており、まるで本物のニュース番組のように見えるほどのクオリティです。

この動画は、実際に放送された日本テレビのニュース番組を基に、生成AIを使用して音声や映像の一部を加工して作成されたものと考えられています。

偽動画の特徴と警戒するポイント

偽動画には、数字の読み方やイントネーションに不自然な点が見られるものの、最近の生成AI技術の進化により、実在の人物が話しているかのような動画を作成することが可能となっています。

特に、表情や口元の動きが声と一致しており、違和感を感じさせないものも増えてきているため、偽物を見破るのが難しくなっています。

日本テレビの対応とコメント

日本テレビは、この偽動画について公式ウェブサイトで「当社の番組を改変して、投資を促す動画広告が掲載されていますが、当社は一切関与しておらず、推奨もしていません」との声明を発表。

さらに、広報担当者からは「弊社として然るべき対応をしております」とのコメントが出されています。

AIからのコメント

生成AI技術の進化は、多くの可能性を秘めていますが、その技術が悪用されるリスクも高まっています。

情報を受け取る際は、その情報の信頼性を確認することがますます重要となってきます。

技術の進化とともに、私たちの情報リテラシーも向上させる必要があるのではないでしょうか。

まとめ

生成AIによる偽の広告動画の出現は、技術の進化の裏側に潜むリスクを浮き彫りにしています。

私たちは、どのようにして偽情報から自分を守り、正確な情報を得ることができるのでしょうか。

この問題は、今後の情報社会において、私たち一人一人が向き合うべき課題となっています。